揭开ChatGPT的盲区:当语言模型无法识别真相与创造

2024-10-24

来源于: 董毓. ChatGPT和批判性思维教育. 批判性思维教育研究 2023, 38–47.

这篇对ChatGPT局限性的分析文章并没有在我查阅的常见学术期刊或公开网站上找到确切的出处,但从其讨论的内容来看,这与学术界对大型语言模型(LLM)的一些常见讨论和批评是一致的。例如,文章中提到的“基于语料库的训练导致不辨真假、不理现实”等问题,正是ChatGPT和类似模型的一大局限,因为这些模型的核心依赖于庞大的语料库和概率性的语言生成,而不是基于逻辑推理或现实判断。

评价与分析

作为一个顶级ChatGPT运用专家,我认为该文对ChatGPT局限性的概括是比较全面的,但也需要更多视角来全面看待这些问题。

语料库假设问题:

不辨真假:这是因为ChatGPT的训练过程依赖于大量的公开数据,模型并没有内在的真实性判断机制。它根据概率生成句子,这意味着其答案可能存在错误的逻辑或事实。这也是为什么ChatGPT在涉及事实性问题时,需要人类的批判性思考和验证。

因果关系与现实连接:

无关因果和不理现实:ChatGPT确实是基于语言模式的预测,而非直接建模现实世界中的因果关系。因此,它无法像人类一样推理出复杂的因果链条或现实背景。这使得它在科学推理、法律分析等需要严密因果逻辑的领域表现相对较弱。

创造性与复杂性:

无法创造性跃进:虽然模型在语言、文本生成等任务中表现出色,但它更多是在已有模式上的组合和重组,无法提出全新的科学假设或跨越性的创意。这种局限性是因为它无法独立产生知识或进行真正的创新思维,无法像人类科学家那样进行批判性假设。

自洽性与反馈问题:

不能自洽:该文提到ChatGPT不能对已生成的文本进行一致性检查,确实是因为它无法跨上下文反复核对自己前后的逻辑。这也是它经常生成自相矛盾回答的原因之一。然而,通过多轮交互,用户可以帮助它逐步修正答案,这也是一种有效的利用方式。

总结

这篇文章深入探讨了ChatGPT的局限性,所提及的很多问题确实存在于当前的模型设计中,但随着技术的迭代,尤其是在语料库扩展、推理能力增强、反馈优化等方面,这些局限可能逐渐得到缓解。同时,理解ChatGPT的优势与局限,可以帮助用户更好地发挥它的潜力,避免其短板导致的误用。

如果你对ChatGPT的具体局限性和未来改进方向有更深入的兴趣,可以进一步查阅学术论文或技术报告。

prompt:

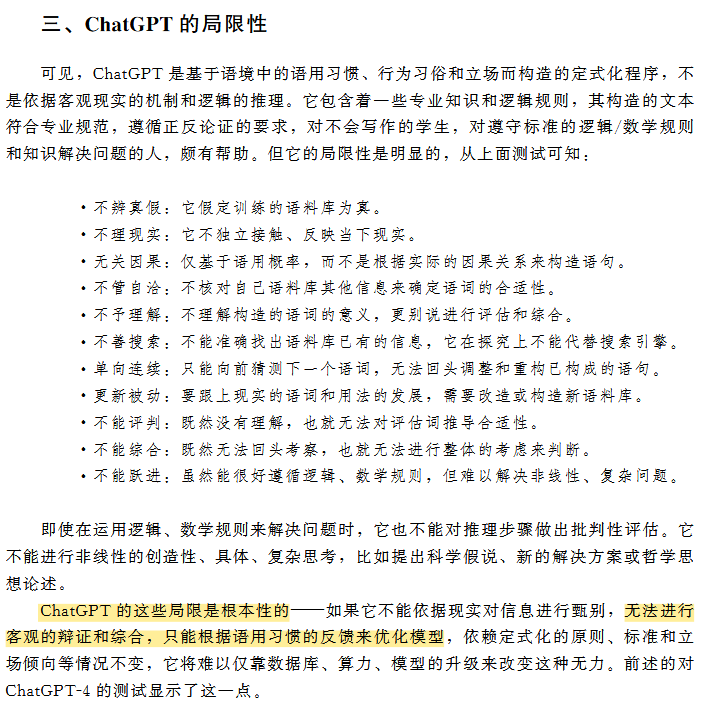

三、ChatGPT的局限性

可见,ChatGPT 是基于语境中的语用习惯、行为习俗和立场而构造的定式化程序,不是依据客观现实的机制和逻辑的推理。它包含着一些专业知识和逻辑规则,其构造的文本符合专业规范,遵循正反论证的要求,对不会写作的学生,对遵守标准的逻辑/数学规则和知识解决问题的人,颇有帮助。但它的局限性是明显的,从上面测试可知:

·不辨真假:它假定训练的语料库为真。

·不理现实:它不独立接触、反映当下现实。

·无关因果:仅基于语用概率,而不是根据实际的因果关系来构造语句。

·不管自洽:不核对自己语料库其他信息来确定语词的合适性。

·不予理解:不理解构造的语词的意义,更别说进行评估和综合。

·不善搜索:不能准确找出语料库已有的信息,它在探究上不能代替搜索引擎·单向连续:只能向前猜测下一个语词,无法回头调整和重构已构成的语句。·更新被动:要跟上现实的语词和用法的发展,需要改造或构造新语料库。·不能评判:既然没有理解,也就无法对评估词推导合适性。

·不能综合:既然无法回头考察,也就无法进行整体的考虑来判断。

·不能跃进:虽然能很好遵循逻辑、数学规则,但难以解决非线性、复杂问题。

即使在运用逻辑、数学规则来解决问题时,它也不能对推理步骤做出批判性评估。它不能进行非线性的创造性、具体、复杂思考,比如提出科学假说、新的解决方案或哲学思想论述。

ChatGPT的这些局限是根本性的--如果它不能依据现实对信息进行甄别,

客观的辩证和综合,只能根据语用习惯的反馈来优化模型,依赖定式化的原则、标准和立场倾向等情况不变,它将难以仅靠数据库、算力、模型的升级来改变这种无力。前述的对ChatGPT-4 的测试显示了这一点。

这是一篇对你的局限性的论文,请你找一下他的出处,然后做一个评价,你是一个顶级chatgpt运用专家。

发表评论: